L’intelligenza artificiale non è più una tecnologia di contorno. Scrive email, bozze di report, riassume notizie e inonda i social media con testi convincenti. Il problema non è che l’IA esista. Il problema è che spesso sembra abbastanza umana da passare inosservata.

Per giornalisti, redattori e fact-checker, questo crea un nuovo rischio professionale. Pubblicare materiale generato dall’IA come se fosse scritto da un umano mina la credibilità, la responsabilità e la fiducia dei lettori.

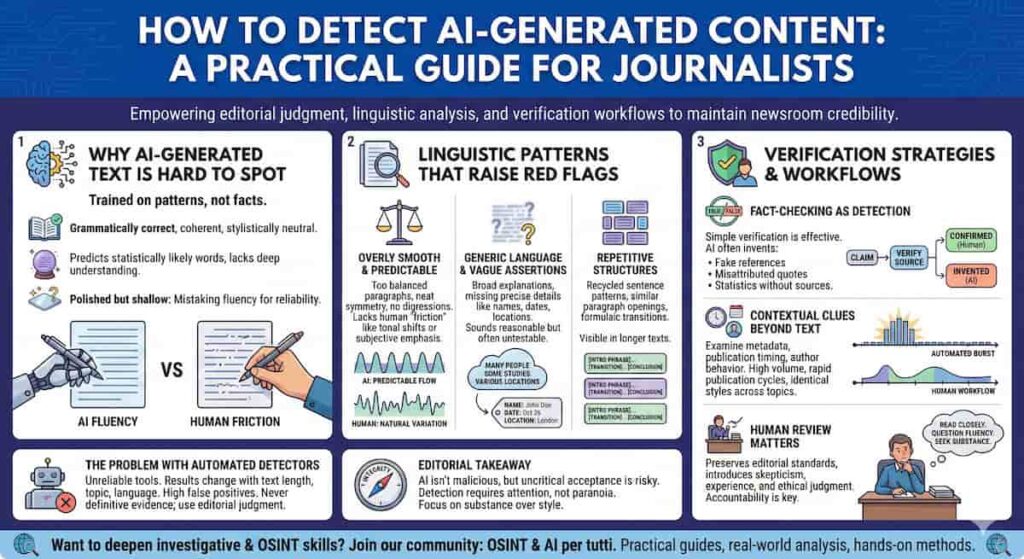

Riconoscere testi generati dall’IA è ora parte integrante dell’alfabetizzazione di una redazione moderna. Questa guida spiega come identificare i contenuti sintetici utilizzando il giudizio editoriale, i segnali linguistici e i flussi di verifica, senza affidarsi ciecamente ai rilevatori automatici.

Perché i testi IA sono difficili da individuare

I grandi modelli linguistici (LLM) sono addestrati su enormi quantità di scrittura esistente.1 Imparano schemi, non fatti. Il loro output tende ad essere grammaticalmente corretto, coerente e stilisticamente neutro. Questo rende il rilevamento difficile, specialmente quando il testo evita errori evidenti.

L’IA non “sa” nulla. Prevede semplicemente quale parola è statisticamente più probabile che venga dopo. Di conseguenza, la sua scrittura suona spesso levigata ma superficiale. Il pericolo sta nel confondere la fluidità sintattica con l’affidabilità del contenuto.

Pattern linguistici che devono allarmare

Scrittura eccessivamente liscia e prevedibile

Il testo generato dall’IA spesso sembra troppo “bilanciato”. I paragrafi scorrono uniformemente. Gli argomenti sono nettamente simmetrici. Ci sono poche interruzioni, digressioni o tocchi personali. La scrittura umana, al contrario, di solito contiene attrito: piccole incongruenze, cambi di tono o enfasi soggettiva.

Quando ogni paragrafo si legge come se fosse stato editato alla perfezione da un correttore di bozze maniacale, lo scetticismo è giustificato.

Linguaggio generico e affermazioni vaghe

Il testo sintetico si basa pesantemente su dichiarazioni generali. Spiega gli argomenti ampiamente senza impegnarsi in dettagli precisi. Nomi, date, luoghi specifici e osservazioni di prima mano sono spesso mancanti o sfumati.

Le affermazioni suonano ragionevoli ma rimangono difficili da testare. Quella vaghezza non è accidentale. È un sottoprodotto tecnico della scrittura basata sulla previsione statistica.

Strutture ripetitive

L’IA tende a riciclare i modelli di frase. Aperture di paragrafo simili, ritmi sintattici ripetuti e transizioni standardizzate (“Inoltre”, “Tuttavia”, “In conclusione”) appaiono frequentemente. Questa ripetizione strutturale diventa più visibile nei testi più lunghi. I redattori dovrebbero scansionare le forme di frase ricorrenti piuttosto che cercare solo le parole ripetute.

Il problema dei rilevatori AI automatici

Gli strumenti software che affermano di riconoscere testi generati dall’IA sono spesso inaffidabili. I loro risultati cambiano drasticamente a seconda della lunghezza del testo, dell’argomento trattato e della lingua utilizzata.

I falsi positivi sono comuni, specialmente per scrittori non madrelingua inglese o per testi umani che sono stati pesantemente editati per chiarezza. Questi strumenti non dovrebbero mai essere trattati come prove definitive. Nel migliore dei casi, offrono segnali deboli. Nel peggiore, creano una sicurezza mal riposta.

Il giudizio editoriale umano rimane più affidabile del punteggio algoritmico.

Il Fact-Checking come strategia di rilevamento

Uno dei modi più efficaci per esporre il testo generato dall’IA è la semplice verifica dei fatti. L’IA inventa frequentemente (le cosiddette “allucinazioni”):2

- Riferimenti accademici o bibliografici inesistenti.

- Citazioni attribuite a persone reali che non le hanno mai pronunciate.

- Statistiche senza fonti tracciabili o palesemente errate.

Controllare anche solo una o due affermazioni fattuali specifiche spesso rivela se il testo è stato prodotto da un sistema che non può verificare la realtà. Se i riferimenti tornano alle stesse fonti vaghe o non possono essere confermati indipendentemente, il sospetto deve aumentare.

Indizi contestuali oltre il testo

Il rilevamento non si limita all’analisi del linguaggio. I metadati, la tempistica di pubblicazione e il comportamento dell’autore contano.

Improvvise raffiche di contenuti ad alto volume, stili di scrittura identici su argomenti completamente diversi o cicli di pubblicazione disumanamente rapidi possono indicare la generazione automatizzata. I flussi di lavoro umani raramente si comportano in quel modo. I redattori dovrebbero esaminare il contesto completo, non solo il paragrafo sullo schermo.

Perché la revisione umana conta ancora

Il rilevamento dell’IA non riguarda la “caccia alle macchine”. Riguarda la conservazione degli standard editoriali.

Il giornalismo si basa sulla responsabilità: qualcuno deve stare dietro a ciò che è scritto e risponderne. L’IA non può essere ritenuta responsabile. Già questo rende la trasparenza sull’uso di questi strumenti essenziale. La revisione umana introduce scetticismo, esperienza e giudizio etico. Queste sono qualità che non possono essere automatizzate.

Il testo generato dall’IA non è intrinsecamente dannoso. Il rischio deriva dall’accettazione acritica. Il rilevamento richiede attenzione, non paranoia. Leggi attentamente. Verifica selettivamente. Metti in discussione la fluidità. Cerca la sostanza, non lo stile. Questa mentalità rimane la difesa più forte in un ambiente informativo saturo di IA.

Vuoi approfondire le tue competenze investigative e di OSINT? Entra a far parte della nostra Community e segui OSINT & AI per tutti per guide pratiche, analisi del mondo reale e metodi pratici utilizzati da giornalisti e ricercatori in tutto il mondo.

-Newsletter https://coondivido.substack.com/

-Telegram: https://t.me/osintaipertutti